La importancia del uso responsable de la IA: cuando no puedes creer en lo que ves

Llevamos un tiempo hablando del uso responsable de la IA (inteligencia artificial), un tema que ha generado un profundo debate alrededor de esta tecnología que, como ya saben muchos de nuestros lectores, está llamada a cambiar por completo el mundo tal y como lo conocemos.

En palabras de Lama Nachman, director del Laboratorio de Investigación de Sistemas Inteligentes en Intel Labs, la inteligencia artificial ha transformado la manera en la que vivimos, y también en la que trabajamos, en la que interactuamos con diversos aspectos de nuestro día a día, y también en la que afrontamos ciertos desafíos.

La inteligencia artificial está ayudando a mejorar la calidad de vida de personas con problemas físicos y psicológicos, y también está haciendo posible avances importantes tanto a nivel médico y científico como en el sector tecnológico, donde la automatización avanzada ha sido sin duda uno de los logros más importantes que ha hecho posible esta tecnología.

Disponer de la inteligencia artificial es contar con un gran poder, y ya sabéis que un gran poder conlleva una gran responsabilidad. Es ahí precisamente donde la idea del uso responsable de la IA adquiere todo su sentido, un tema que Intel trató a fondo recientemente en una mesa redonda a la que tuvimos la oportunidad de asistir, y en la que el gigante del chip confirmó que aspira a ser un modelo a seguir por su uso ético de la inteligencia artificial.

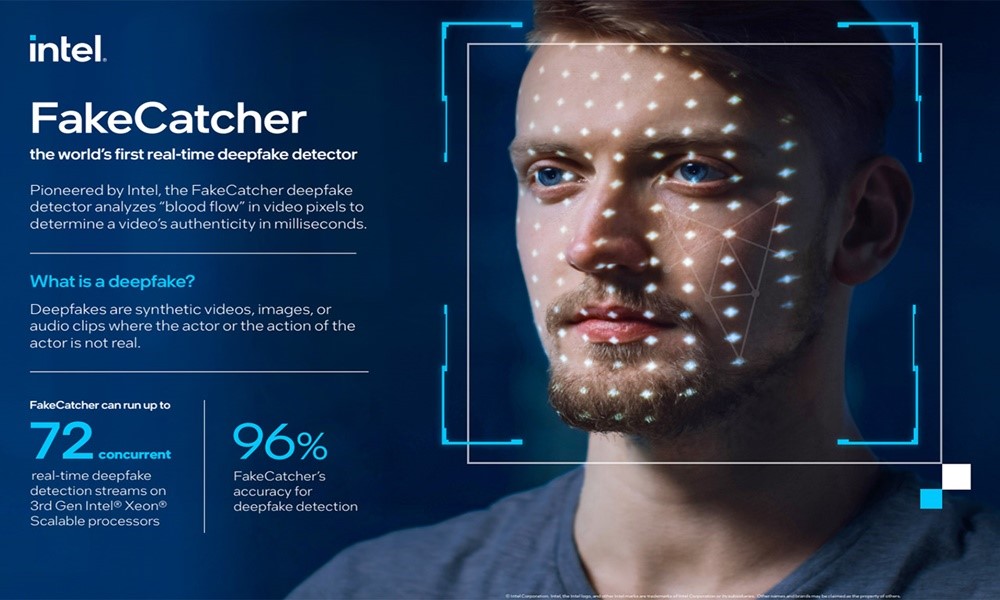

Piensa, por un momento, en todos los peligros que entrañaría un uso indebido de la inteligencia artificial. En este sentido los «deep fakes» son uno de los problemas más graves porque, al final, ¿qué te queda cuando no puedes creer lo que estás viendo, incluso aunque esto parezca totalmente real? Esta fue una de las cuestiones que más interesante me pareció de todas las que se tocaron en esa mesa redonda, porque representa uno de los problemas más importantes de todos los que se asocian al uso indebido de la inteligencia artificial avanzada.

Intel ha sido una de las compañías que más esfuerzos ha hecho para luchar contra los «deep fakes», pero este no ha sido su único movimiento para reforzar ese uso responsable de la IA. Durante la celebración de la mesa redonda Lama Nachman confirmó otras claves e iniciativas importantes que podéis encontrar resumidas en este enlace.

Mejorar la seguridad y la accesibilidad, impulsar la sanidad y la investigación médica y científica, ampliar el acceso a la educación y crear soluciones para cuidar el medio ambiente y reducir el impacto de la radiación en las misiones espaciales son algunas de esas iniciativas, y la inclusión, la diversidad, la privacidad y la seguridad son algunos de los pilares que sustentan la base del uso de la IA por parte de Intel.